Washington, 28. Februar 2026 – Berlin Morgen Zeitschrift, In einem beispiellosen Schritt gegen die heimische KI-Industrie hat US-Präsident Donald Trump angeordnet, die Zusammenarbeit mit dem KI-Startup Anthropic einzustellen. Das Pentagon stufte das Unternehmen offiziell als Anthropic Versorgungsrisiko (Supply-Chain Risk) ein – ein Status, der bisher meist feindlichen ausländischen Firmen vorbehalten war. Hintergrund ist ein tiefes Zerwürfnis über ethische Leitplanken: Anthropic-CEO Dario Amodei weigerte sich, Einschränkungen für autonome Waffensysteme und Massenüberwachung aufzugeben. Während Konkurrent OpenAI unter Sam Altman prompt in die Bresche sprang und einen Deal mit dem nun umbenannten „Kriegsministerium“ unterzeichnete, droht Anthropic die totale Isolierung vom Regierungsmarkt.

Experten bezeichnen das Blacklisting als „vertraglichen Atomkrieg“, der nicht nur die Existenz des Startups gefährdet, sondern auch ein Signal an alle US-Tech-Firmen sendet, die nationale Sicherheitsvorgaben hinterfragen.

Strategische Neuausrichtung im Kriegsministerium

Die Spannungen zwischen der Trump-Administration und Anthropic erreichten ihren Höhepunkt, als das Verteidigungsministerium – nun offiziell in Kriegsministerium umbenannt – eine fundamentale Änderung in der Beschaffungsstrategie bekannt gab. Grund für die Einstufung als Anthropic Versorgungsrisiko ist die Weigerung des Start-ups, seine ethischen „Guardrails“ für militärische Zwecke zu lockern. Während die US-Regierung volle operative Freiheit bei der Implementierung von KI in Waffensystemen fordert, beharrt Anthropic auf strikten Sicherheitsvorkehrungen gegen Massenüberwachung und autonome Tötungsentscheidungen.

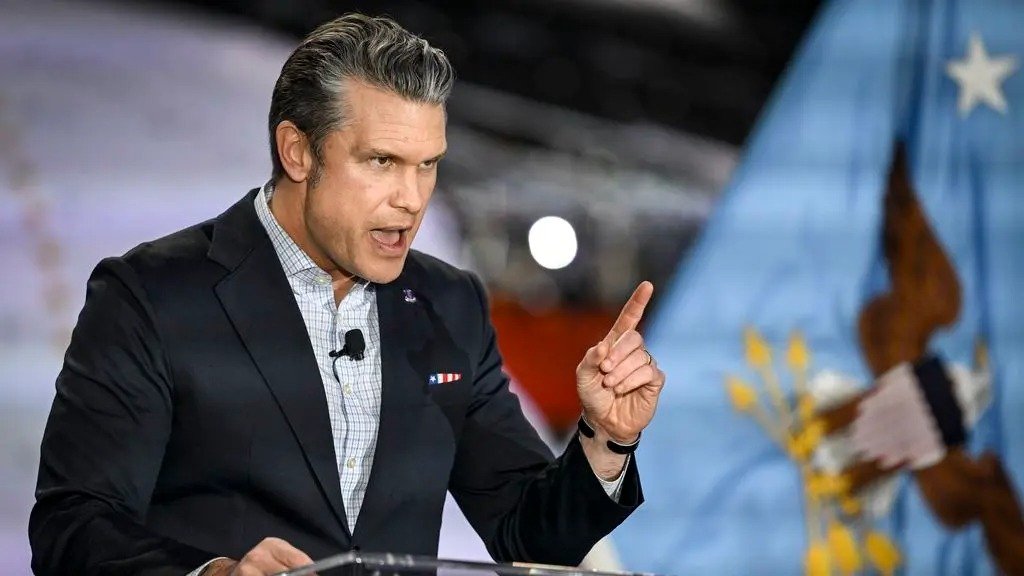

Verteidigungsminister Pete Hegseth betonte, dass die nationale Sicherheit nicht von den moralischen Vorstellungen privater Firmen abhängig sein dürfe. Durch die Deklaration als Anthropic Versorgungsrisiko wird es Zehntausenden von Regierungsmitarbeitern und Auftragnehmern untersagt, die Technologie des Unternehmens weiterhin zu nutzen. Dies betrifft insbesondere das Sprachmodell Claude, das bisher tief in die Analyseprozesse verschiedener Geheimdienste integriert war.

Der Sechs-Monate-Countdown für die KI-Infrastruktur

Präsident Trump hat eine Übergangsfrist von sechs Monaten festgelegt, in der alle Bundesbehörden ihre Abhängigkeit von Anthropic-Produkten beenden müssen. Sollte das Unternehmen diesen Prozess behindern, drohte der Präsident mit drastischen Konsequenzen. Die Einstufung als Anthropic Versorgungsrisiko gibt der Regierung weitreichende rechtliche Werkzeuge an die Hand, um Compliance einzufordern.

Für Experten in Washington ist dieser Schritt vergleichbar mit der Kampagne gegen Huawei im Jahr 2017. Doch die Ironie liegt darin, dass Anthropic ein US-amerikanisches Unternehmen ist, das massiv von Tech-Giganten wie Google und Amazon unterstützt wird. Das Label Anthropic Versorgungsrisiko könnte daher nicht nur die staatlichen Aufträge, sondern auch die gesamte zivile Geschäftsbasis des Unternehmens zerstören, da Unternehmen weltweit vor der Zusammenarbeit mit einer „Blacklist-Firma“ zurückschrecken könnten.

OpenAI füllt das Machtvakuum

Während Anthropic mit dem Stigma kämpft, ein Anthropic Versorgungsrisiko zu sein, hat der Konkurrent OpenAI die Gunst der Stunde genutzt. Sam Altman verkündete kürzlich eine weitreichende Kooperation mit dem Pentagon. OpenAI hat zugestimmt, technische Sicherheitsvorkehrungen so zu gestalten, dass sie den Anforderungen des Kriegsministeriums entsprechen.

Dieser Deal unterstreicht die tiefe Spaltung innerhalb der KI-Community. Während die einen Anthropic für seine standhafte Haltung bewundern, sehen andere in der Einstufung als Anthropic Versorgungsrisiko eine notwendige Konsequenz für Firmen, die sich der nationalen Verteidigungsstrategie entziehen. Das Pentagon machte deutlich, dass man keine „unzuverlässige KI“ in kritischen Systemen dulden werde, die durch externe ethische Filter blockiert werden könnte.

Die rechtliche Gegenoffensive von Anthropic

Anthropic lässt diese Einstufung nicht kampflos hinnehmen. In einer offiziellen Stellungnahme kündigte das Unternehmen an, die Entscheidung des Verteidigungsministeriums vor Gericht anzufechten. Sie argumentieren, dass das Label Anthropic Versorgungsrisiko rechtlich unhaltbar sei und einen gefährlichen Präzedenzfall für die gesamte amerikanische Wirtschaft schaffe.

Besonders kritisch sieht das Unternehmen die potenzielle Verpflichtung zur Mitwirkung an Systemen für die Massenüberwachung. Für Dario Amodei, den CEO von Anthropic, geht es hierbei um mehr als nur Verträge; es geht um die Seele der künstlichen Intelligenz. Doch in der aktuellen politischen Landschaft Washingtons wiegt das Argument der nationalen Überlegenheit schwerer als ethische Bedenken, was die Aufhebung des Status als Anthropic Versorgungsrisiko erschweren dürfte.

Auswirkungen auf Google und Amazon

Die finanziellen Folgen dieser Entscheidung sind noch nicht vollständig absehbar, aber die Märkte reagierten bereits nervös. Da Google und Amazon zu den Hauptinvestoren von Anthropic gehören, betrifft die Einstufung als Anthropic Versorgungsrisiko auch deren strategische Interessen. Sollte Anthropic dauerhaft vom Regierungsmarkt ausgeschlossen bleiben, steht eine Milliarden-Bewertung auf dem Spiel.

Analysten weisen darauf hin, dass dies erst der Anfang einer größeren Regulierungswelle sein könnte. Wenn ein Unternehmen als Anthropic Versorgungsrisiko markiert werden kann, weil es sich weigert, seine Algorithmen für militärische Zwecke zu öffnen, müssen alle anderen Anbieter ihre Geschäftsmodelle überdenken. Die Grenze zwischen privater Technologieentwicklung und staatlicher Dienstleistung verschwimmt im Jahr 2026 zusehends.

Ein drakonisches Exempel für das Silicon Valley

Die Drastik der Maßnahme wird besonders deutlich, wenn man bedenkt, dass bisher kein anderes US-KI-Unternehmen in dieser Form sanktioniert wurde. Saif Khan, ein ehemaliger Mitarbeiter des Nationalen Sicherheitsrats, bezeichnete die Einstufung als Anthropic Versorgungsrisiko als die wohl härteste inländische Regulierung in der Geschichte der Technologiebranche. Es wird ein Exempel statuiert, das zeigt, dass die Regierung bereit ist, technologische Führungspositionen zu opfern, um absolute Kontrolle über die Verteidigungsinfrastruktur zu behalten.

Die Debatte um „Killer-Roboter“ und automatisierte Kriegsführung hat durch diesen Konflikt eine neue Dimension erreicht. Was früher theoretische Diskussionen in Ethik-Kommissionen waren, ist nun ein handfester politischer Krieg. Das Anthropic Versorgungsrisiko ist das greifbare Ergebnis dieser unvereinbaren Positionen zwischen technologischer Verantwortung und militärischer Notwendigkeit.

Franklin Turner, ein führender Experte für Regierungsverträge, fasst die Schwere der Situation zusammen:

„Das Blacklisting von Anthropic ist das vertragliche Äquivalent zu einem Atomkrieg.“

Geopolitische Konsequenzen der US-Entscheidung

International wird die Einstufung als Anthropic Versorgungsrisiko genau beobachtet. Verbündete der USA stehen nun vor der Frage, ob sie die Technologie von Anthropic weiterhin nutzen können, ohne die Beziehung zum Pentagon zu gefährden. Wenn die USA ein eigenes Unternehmen als Sicherheitsrisiko einstufen, wird es für europäische oder asiatische Behörden schwierig, Claude weiterhin für sensible Datenanalysen einzusetzen.

Dies könnte zu einer Fragmentierung des KI-Marktes führen, in dem sich Unternehmen entscheiden müssen, ob sie „government-ready“ oder „ethics-first“ agieren wollen. Das Anthropic Versorgungsrisiko fungiert hierbei als der ultimative Trennstrich. Es bleibt abzuwarten, ob andere Nationen diesem Beispiel folgen oder ob Anthropic in Übersee neue Nischen findet, die weniger militärisch geprägt sind.

Der juristische Showdown in Washington

In den kommenden Monaten wird sich der Kampf in die Gerichtssäle von Washington verlagern. Anthropic wird versuchen nachzuweisen, dass die Entscheidung des Pentagons willkürlich und politisch motiviert war. Die Verteidigung wird argumentieren, dass Sicherheit durch Transparenz und Ethik erhöht wird, nicht durch deren Entfernung. Doch solange das Label Anthropic Versorgungsrisiko besteht, bleibt das Unternehmen in einem lähmenden Zustand der Ungewissheit, der Investoren abschreckt und Talente zur Konkurrenz treibt.

Das Ende der KI-Neutralität im Silicon Valley

Mit diesem Schritt endet die Ära der neutralen KI-Entwicklung. Das Jahr 2026 wird als das Jahr in die Geschichte eingehen, in dem die US-Regierung klarstellte, dass technologische Innovation im Dienste der nationalen Stärke zu stehen hat. Das Anthropic Versorgungsrisiko ist kein bloßer bürokratischer Akt, sondern eine politische Neudefinition der Beziehung zwischen Staat und Tech-Industrie. Unternehmen müssen nun Farbe bekennen: Entweder sie folgen den Vorgaben des Kriegsministeriums, oder sie riskieren, als Risiko für die eigene Nation gebrandmarkt zu werden.

Digitale Souveränität unter dem Banner des Adlers

Die Neuausrichtung unter Trump zeigt, dass digitale Souveränität im Jahr 2026 bedeutet, dass die Werkzeuge der Macht bedingungslos funktionieren müssen. Jede Form von „eingebauter Verweigerung“ durch KI-Modelle wird als Schwäche und Sicherheitslücke interpretiert. Die Causa Anthropic wird somit zur Blaupause für künftige Auseinandersetzungen mit Start-ups, die versuchen, moralische Standards über staatliche Interessen zu stellen. Es ist ein harter Weckruf für das Silicon Valley, dass die Freiheit der Algorithmen an den Toren des Pentagons endet.